SUB30

SUB30

Lädt...

LLM-Add-on (BYOK vs Managed)

Wie LLM auf ClawHosters funktioniert

Jede OpenClaw-Instanz kann ein großes Sprachmodell (LLM) für Gespräche, Aufgaben und Automatisierungen nutzen. ClawHosters bietet zwei Wege, eines zu verbinden: eigenen API-Schlüssel mitbringen oder ein verwaltetes Paket buchen.

BYOK (Bring Your Own Key)

BYOK erlaubt dir, API-Schlüssel zu verwenden, die du bereits bei Anbietern wie Anthropic, OpenAI oder Google hast. ClawHosters berechnet dafür nichts. Du zahlst direkt an deinen Anbieter.

Unterstützte Anbieter

- Anthropic: Claude Opus, Sonnet, Haiku

- OpenAI: GPT-4, GPT-4 Turbo, GPT-3.5, o1

- Google AI: Gemini-Modelle

- DeepSeek: DeepSeek V3 und weitere

- OpenRouter: Zugriff auf mehrere Anbieter über einen einzigen Schlüssel

- Mistral: Mistral-Modelle

- Groq: Schnelle Inferenz-Modelle

BYOK einrichten

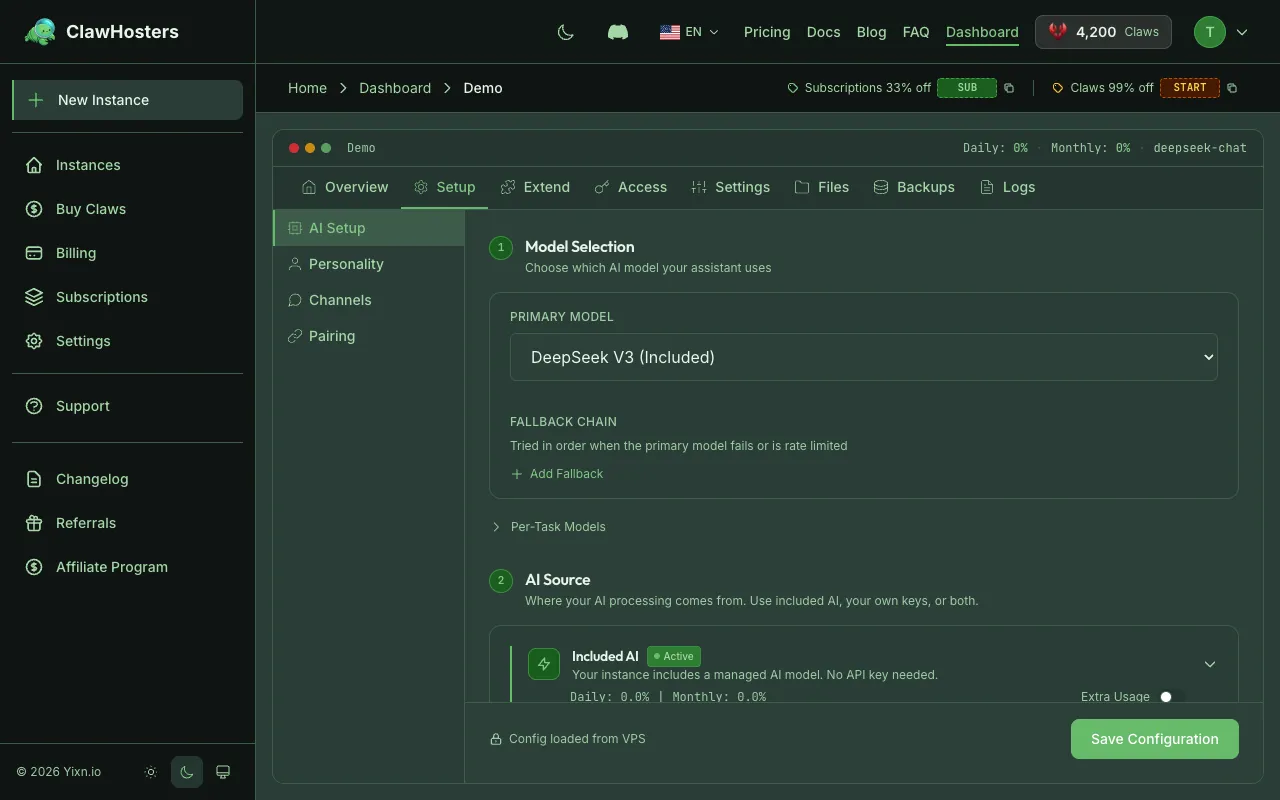

- Öffne deine Instanz im ClawHosters-Dashboard

- Gehe zum AI Setup-Tab

- Unter Eigene API-Keys (BYOK) klicke auf Anbieter hinzufügen

- Wähle deinen Anbieter aus dem Dropdown

- Füge deinen API-Schlüssel ein

- Klicke auf Speichern

Das System führt einen kurzen Testaufruf bei deinem Anbieter durch, um zu bestätigen, dass der Schlüssel funktioniert. Wenn die Verifizierung erfolgreich ist, kann deine Instanz die Modelle dieses Anbieters sofort nutzen.

Info: API-Schlüssel werden verschlüsselt gespeichert. ClawHosters speichert sie nie im Klartext.

Warum BYOK wählen

- Keine zusätzlichen Kosten von ClawHosters

- Nutze jedes Modell, das dein Anbieter unterstützt, auch die neuesten Releases

- Keine Token-Limits auf ClawHosters-Seite (die Limits deines Anbieters gelten)

- Ideal für Teams, die bereits Verträge mit einem Anbieter haben

Verwaltete Pakete (Managed Packs)

Wenn du keine eigenen API-Schlüssel hast oder eine einfachere Lösung bevorzugst, bieten verwaltete Pakete ein festes monatliches Token-Kontingent zu einem festen Preis. ClawHosters kümmert sich um die API-Schlüssel und das Routing.

Verfügbare Stufen

| Stufe | Modell | Am besten für |

|---|---|---|

| Eco | DeepSeek V3 | Allgemeine Aufgaben, bestes Preis-Leistungs-Verhältnis |

| Standard | Gemini Flash-Lite | Schnelle Antworten, zuverlässige Leistung |

| Premium | Claude Haiku | Komplexes Reasoning, differenzierte Gespräche |

Jede Stufe verwendet ein bestimmtes Modell. Du kannst innerhalb einer Stufe nicht das Modell wechseln.

Preise und Token-Kontingente

Eco (DeepSeek V3)

| Paket | Tokens/Monat | Monatspreis |

|---|---|---|

| Starter | 1.000.000 | 3 € |

| Standard | 5.000.000 | 10 € |

| Pro | 15.000.000 | 25 € |

Standard (Gemini Flash-Lite)

| Paket | Tokens/Monat | Monatspreis |

|---|---|---|

| Starter | 1.000.000 | 5 € |

| Standard | 5.000.000 | 15 € |

| Pro | 15.000.000 | 40 € |

Premium (Claude Haiku)

| Paket | Tokens/Monat | Monatspreis |

|---|---|---|

| Starter | 1.000.000 | 12 € |

| Standard | 3.000.000 | 30 € |

| Pro | 8.000.000 | 70 € |

Verwaltetes Paket einrichten

- Öffne deine Instanz im ClawHosters-Dashboard

- Gehe zum AI Setup-Tab

- Unter Inkludierte KI wähle Verwaltetes Paket

- Wähle eine Stufe (Eco, Standard oder Premium)

- Wähle eine Paketgröße (Starter, Standard oder Pro)

- Bestätige dein Abonnement

Das LLM ist sofort nach der Buchung verfügbar. Die Token-Nutzung beginnt mit der ersten Anfrage.

Token-Tracking

Jede LLM-Anfrage wird in Echtzeit erfasst. Sowohl Input-Tokens (was du sendest) als auch Output-Tokens (was das Modell antwortet) zählen zum Paket-Limit.

Die aktuelle Nutzung siehst du im AI Setup-Tab im Dashboard:

- Verbrauchte Tokens: Wie viele Tokens du in diesem Zeitraum genutzt hast

- Verbleibende Tokens: Wie viele dir noch zur Verfügung stehen

- Nutzungsanteil: Eine visuelle Anzeige des Verbrauchs

Was passiert, wenn dein Kontingent aufgebraucht ist

Wenn ein verwaltetes Paket keine Tokens mehr hat, geben weitere LLM-Anfragen einen Fehler zurück, bis:

- Dein Paket am Anfang des nächsten Abrechnungszeitraums zurückgesetzt wird

- Du auf ein größeres Paket wechselst

Deine Instanz läuft normal weiter. Nur LLM-Anfragen sind betroffen. Alle anderen Funktionen (Messaging, Kanäle, Automatisierungen) funktionieren weiterhin.

Info: BYOK-Abonnements haben keine Token-Limits auf ClawHosters-Seite. Die Nutzung wird zu deiner Übersicht erfasst, aber nie blockiert.

BYOK vs Managed: Schnellvergleich

| BYOK | Verwaltetes Paket | |

|---|---|---|

| Kosten | Kostenlos (du zahlst deinen Anbieter) | 3–70 €/Monat |

| Modellauswahl | Jedes Modell, das dein Schlüssel unterstützt | Festes Modell pro Stufe |

| Token-Limits | Keine von ClawHosters | Paketbasiert (1M–15M) |

| Einrichtung | API-Schlüssel hinzufügen | Paket abonnieren |

| Am besten für | Power-User, spezielle Modellanforderungen | Einfachheit, planbare Kosten |

Datenschutz und Jurisdiktion der Modelle

Wenn deine Instanz einen Prompt an ein LLM sendet, verlässt diese Anfrage deinen deutschen VPS und geht an die Server des Modellanbieters. Wo diese Server stehen und wie der Anbieter deine Daten behandelt, hängt vom jeweiligen Modell ab.

Inkludierte Modelle (kostenlos in jedem Plan)

Diese Modelle sind in jedem ClawHosters-Plan ohne Zusatzkosten verfügbar. ClawHosters bezahlt den API-Zugang.

| Modell | Anbieter | Hauptsitz / Jurisdiktion | US CLOUD Act? | Datentraining | Server in China |

|---|---|---|---|---|---|

| Gemini 2.5 Flash Lite | USA | Ja | Nein (bezahlte API-Nutzung laut Googles API-Bedingungen ausgeschlossen) | Nein | |

| DeepSeek R1 | DeepSeek | China (Hangzhou) | Nein | Richtlinie weniger transparent, aktuelle API-Bedingungen prüfen | Ja |

| DeepSeek V3 (Chat) | DeepSeek | China (Hangzhou) | Nein | Richtlinie weniger transparent, aktuelle API-Bedingungen prüfen | Ja |

| Kimi K2.5 | Moonshot AI | China (Peking) | Nein | Richtlinie weniger transparent, aktuelle API-Bedingungen prüfen | Ja |

Googles API-Bedingungen besagen, dass bezahlte API-Daten nicht für Modelltraining verwendet werden. Da ClawHosters für den Gemini-API-Zugang bezahlt, zählt deine Nutzung als bezahlt und fällt unter diesen Ausschluss.

DeepSeek und Moonshot AI haben weniger transparente Datenschutzrichtlinien. Ihre API-Bedingungen können sich ändern. Wenn dir das wichtig ist, prüfe ihre aktuellen Bedingungen direkt.

Modelle der verwalteten Pakete

| Modell | Anbieter | Hauptsitz / Jurisdiktion | US CLOUD Act? | Server in China |

|---|---|---|---|---|

| DeepSeek V3 (Eco-Stufe) | DeepSeek | China (Hangzhou) | Nein | Ja |

| Gemini Flash-Lite (Standard-Stufe) | USA | Ja | Nein | |

| Claude Haiku (Premium-Stufe) | Anthropic | USA | Ja | Nein |

Anthropic gibt an, dass API-Daten standardmäßig nicht für Training verwendet werden.

BYOK-Anbieter und Jurisdiktionen

| Anbieter | Hauptsitz | US CLOUD Act? | EU-basiert |

|---|---|---|---|

| Anthropic (Claude) | USA | Ja | Nein |

| OpenAI (GPT) | USA | Ja | Nein |

| Google AI (Gemini) | USA | Ja | Nein |

| DeepSeek | China | Nein | Nein |

| Mistral | Frankreich | Nein | Ja |

| OpenRouter | USA | Ja | Nein |

| Groq | USA | Ja | Nein |

EU-konforme Alternative

Wenn dir EU-Jurisdiktion wichtig ist, ist Mistral die beste Option unter den unterstützten BYOK-Anbietern. Mistral ist ein französisches Unternehmen mit Servern in der EU, vollständig DSGVO-konform und weder dem US CLOUD Act noch chinesischen Datengesetzen unterworfen. Du kannst dir einen API-Schlüssel auf mistral.ai holen und ihn unter AI Setup > Eigene API-Keys (BYOK) hinzufügen. BYOK ist auf unserer Seite kostenlos.

Was ClawHosters kontrolliert

Deine Instanz-Infrastruktur läuft auf Hetzner Cloud in Deutschland. Chatverlauf, Konfiguration und alle gespeicherten Daten bleiben in Deutschland. ClawHosters leitet LLM-Anfragen über unsere Infrastruktur weiter, speichert aber weder Prompt-Inhalte noch Antworten. Die Unterscheidung ist: Deine Daten im Ruhezustand bleiben in Deutschland, aber die Inferenz findet auf den Servern des Modellanbieters statt.

Alle Details zur Datenverarbeitung findest du unter Datenverarbeitung und Datenschutz.

Anbieter-Failover

Bei verwalteten Paketen leitet das System Anfragen automatisch über einen Backup-Anbieter, wenn der primäre Anbieter ausfällt. Das passiert transparent. Du musst nichts tun. Die Antwortqualität bleibt gleich, weil der Backup ein gleichwertiges Modell nutzt.

BYOK-Anfragen nutzen deinen Schlüssel direkt und haben kein automatisches Failover.

Fehlerbehebung

Fehler „Kein LLM konfiguriert"

- Überprüfe, ob du ein aktives LLM-Abonnement oder BYOK-Credential für diese Instanz hast

- Prüfe im AI Setup-Tab, ob der Abonnement-Status „Aktiv" ist

BYOK-Schlüsselüberprüfung fehlgeschlagen

- Stelle sicher, dass du den vollständigen API-Schlüssel ohne zusätzliche Leerzeichen kopiert hast

- Prüfe, ob der Schlüssel bei deinem Anbieter noch gültig und nicht widerrufen ist

- Bestätige, dass der Schlüssel die richtigen Berechtigungen hat (die meisten Anbieter erfordern mindestens Chat/Completions-Zugriff)

„Nutzungslimit überschritten" beim verwalteten Paket

- Das Token-Kontingent deines Pakets für diesen Zeitraum ist aufgebraucht

- Wechsle zu einem größeren Paket oder warte auf den nächsten Abrechnungszyklus

- Erwäge einen Wechsel zu BYOK, wenn du regelmäßig dein Limit erreichst

Langsame Antworten

- Eco-Stufe (DeepSeek) und Standard-Stufe (Gemini) sind in der Regel schnell

- Premium-Stufe (Claude Haiku) kann bei komplexen Anfragen etwas höhere Latenz haben

- Netzwerkbedingungen zwischen ClawHosters-Infrastruktur und dem Anbieter können die Geschwindigkeit beeinflussen

Verwandte Dokumentation

- Eigene LLM-Anbieter: Jeden OpenAI-kompatiblen Anbieter nutzen (Featherless, Together AI, Ollama, etc.)

- Claws verstehen (Credits): Wie das Creditsystem funktioniert

- Abrechnungsübersicht: Monatliche vs. tägliche Abrechnung

- Instanzübersicht: Was in deiner Instanz läuft

Verwandte Dokumentation

Was ist ClawHosters?

Managed OpenClaw Hosting ClawHosters ist eine Managed-Hosting-Plattform für OpenClaw KI-Assisten...

Schnellstart-Anleitung

Bevor du loslegst Du brauchst einen ClawHosters-Account. Falls du noch keinen hast, geh auf claw...

Eigene LLM-Anbieter

Eigene LLM-Anbieter nutzen Der AI Setup-Tab listet gängige Anbieter wie Anthropic, OpenAI, Googl...