SUB30

SUB30

Lädt...

Was ist OpenClaw?

Ein Open-Source KI-Assistent zum Selbsthosten

OpenClaw ist ein Open-Source-Framework, mit dem du deinen eigenen KI-Assistenten betreiben kannst. Es verbindet sich mit großen Sprachmodellen (Claude, GPT, Gemini, DeepSeek und weitere) und macht sie über Messenger-Plattformen wie Telegram, WhatsApp, Discord und Slack erreichbar.

Du gibst einen LLM-API-Key ein, verbindest einen Messaging-Kanal, und OpenClaw übernimmt den Rest: Nachrichtenweiterleitung, Gesprächskontext, Tool-Nutzung und Multi-Plattform-Support. Eine Instanz kann mehrere Kanäle gleichzeitig bedienen.

Was OpenClaw macht

Im Kern ist OpenClaw ein Gateway zwischen LLM-Anbietern und Messaging-Plattformen. Es:

- Leitet Nachrichten von verbundenen Kanälen an dein gewähltes LLM weiter und gibt die Antworten zurück.

- Verwaltet den Gesprächskontext, damit sich der Assistent an frühere Nachrichten im Chat erinnert.

- Unterstützt Tool-Nutzung und Plugins, die die Fähigkeiten des Assistenten erweitern (Websuche, Code-Ausführung, Dateiverarbeitung).

- Bedient mehrere Kanäle gleichzeitig von einer einzigen Instanz aus. Du kannst auf Telegram und Discord zur selben Zeit chatten.

- Läuft lokal oder auf einem Server. Es ist eine Node.js-Anwendung, verpackt als Docker-Container.

Unterstützte Messaging-Plattformen

| Plattform | Verbindungsmethode |

|---|---|

| Telegram | Bot-Token über BotFather |

| QR-Code-Kopplung | |

| Discord | Bot-Token über das Discord Developer Portal |

| Slack | Slack-App mit OAuth |

| Web-UI | Eingebautes Gateway-Interface (kein Setup nötig) |

Jede Plattform verbindet sich über das OpenClaw Gateway. Du konfigurierst den Kanal einmal, und Nachrichten fließen zwischen deinen Nutzern und dem KI-Assistenten.

Unterstützte LLM-Anbieter

OpenClaw unterstützt die wichtigsten LLM-Anbieter direkt. Die gängigsten Optionen:

- Anthropic (Claude). Stark bei Programmierung, Analyse und Aufgaben mit langem Kontext.

- OpenAI (GPT-4o, o1). Universell einsetzbar, breit unterstützt.

- Google (Gemini). Gute Balance aus Geschwindigkeit und Leistung.

- DeepSeek (V3). Kostengünstige Option für leichtere Aufgaben.

- OpenRouter. Aggregator mit Zugriff auf über 200 Modelle über einen einzigen API-Key.

Du bringst deinen eigenen API-Key mit (BYOK). OpenClaw leitet Anfragen direkt an deinen Anbieter weiter. Dein Key, dein Verbrauch, deine Kosten.

Die Herausforderung beim Selbsthosten

OpenClaw ist kostenlos nutzbar. Der Code ist Open Source. Aber es selbst zu betreiben bedeutet:

- Server bereitstellen. VPS mieten, Betriebssystem einrichten, Abhängigkeiten installieren.

- Docker konfigurieren. Container-Image bauen oder pullen, Compose-Dateien schreiben, Volumes verwalten.

- Sicherheit härten. Firewall-Regeln, Brute-Force-Schutz, SSH-Key-Verwaltung, Pakete aktuell halten.

- SSL-Zertifikate. HTTPS für das Gateway-Interface einrichten.

- Monitoring. Abstürze, Speicherlecks und Festplattenprobleme überwachen.

- Updates. Neue Versionen pullen, testen, bei Problemen zurückrollen.

Für Entwickler mit DevOps-Erfahrung ist das machbar. Für alle anderen ist es eine Hürde.

Wo ClawHosters ins Spiel kommt

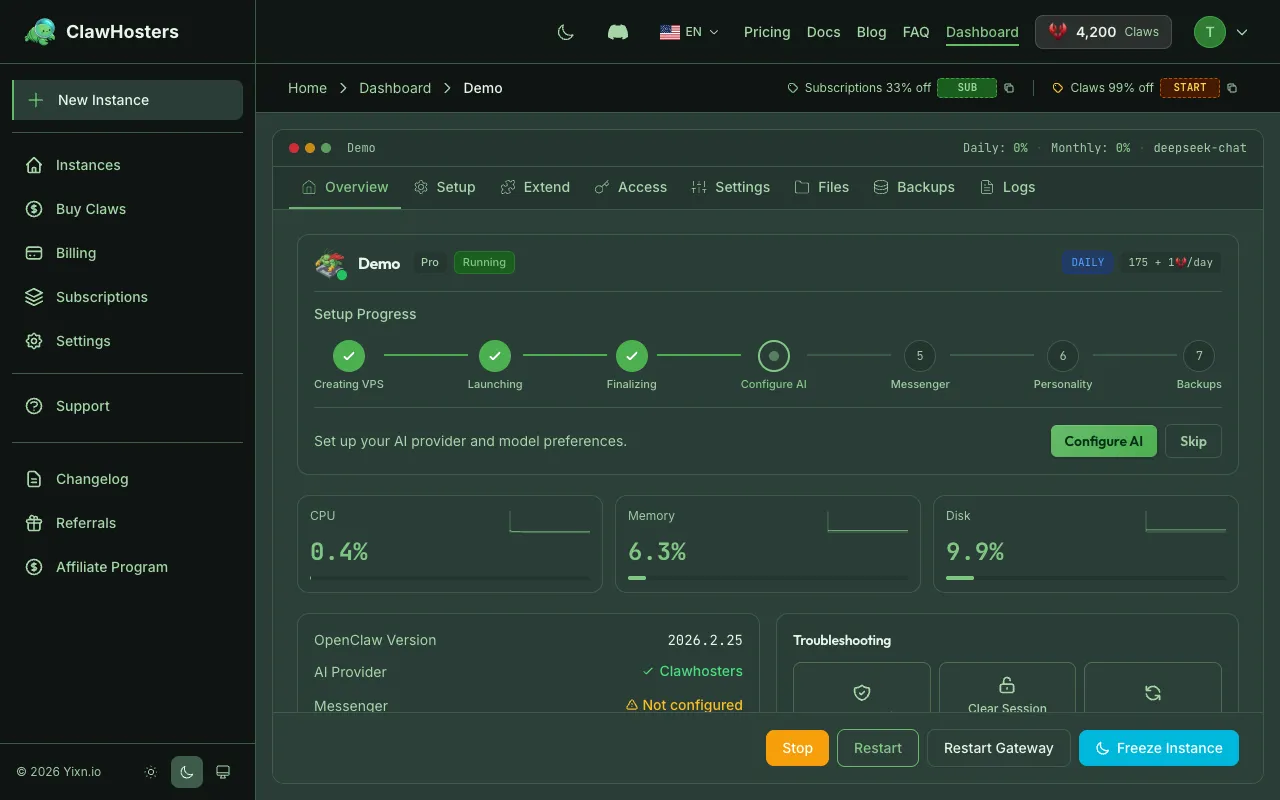

ClawHosters nimmt dir die Infrastrukturarbeit ab. Statt Server und Docker einzurichten, klickst du einen Button und hast in etwa 60 Sekunden eine laufende OpenClaw-Instanz.

Alles, was Selbsthosten mühsam macht, wird für dich erledigt:

- Dedizierter VPS wird automatisch auf Hetzner-Infrastruktur in Deutschland bereitgestellt.

- Sicherheitshärtung wird beim Setup angewendet (Firewall, Brute-Force-Schutz, Container-Isolation).

- Vorkonfiguriertes Gateway, bereit für Kanalverbindungen.

- Web-Dashboard zur Verwaltung von Instanzen, Statusüberwachung und Einstellungen.

- Tägliche oder monatliche Abrechnung mit transparenten Preisen und ohne versteckte Kosten.

Du bringst weiterhin deinen eigenen LLM-Key mit und wählst, welche Kanäle du verbinden willst. Der Unterschied: Du überspringst die Serververwaltung komplett.

OpenClaw-Architektur (vereinfacht)

┌─────────────┐ ┌──────────────┐ ┌─────────────┐

│ Telegram │────▶│ │────▶│ Anthropic │

│ WhatsApp │────▶│ OpenClaw │────▶│ OpenAI │

│ Discord │────▶│ Gateway │────▶│ Google │

│ Slack │────▶│ │────▶│ DeepSeek │

│ Web-UI │────▶│ │────▶│ OpenRouter │

└─────────────┘ └──────────────┘ └─────────────┘

Kanäle Gateway LLM-Anbieter

Nachrichten kommen von verbundenen Kanälen, passieren das Gateway (das Kontext hinzufügt und Tool-Aufrufe verarbeitet) und werden an deinen LLM-Anbieter weitergeleitet. Antworten fließen auf dem gleichen Weg zurück.

Wichtige technische Details

- Runtime: Node.js 22

- Paketierung: Docker-Container (

ghcr.io/phioranex/openclaw-docker:latest) - Gateway: Über Web-Interface auf ClawHosters zugänglich

- Konfiguration:

openclaw.json-Datei für Plugins, Kanäle und Einstellungen - Speicher: Persistentes Docker-Volume für Gesprächsverläufe und Konfiguration

Nächste Schritte

- Was ist ClawHosters? erklärt die Hosting-Plattform und die verfügbaren Tiers.

- Schnellstart-Anleitung führt dich durch die Erstellung deiner ersten gehosteten Instanz.

Verwandte Dokumentation

Was ist ClawHosters?

Managed OpenClaw Hosting ClawHosters ist eine Managed-Hosting-Plattform für OpenClaw KI-Assisten...

Multi-Kanal-Einrichtung

Mehrere Kanäle gleichzeitig nutzen Deine OpenClaw-Instanz unterstützt die gleichzeitige Verbindu...

Teamarbeit

Ein gemeinsamer KI-Assistent für dein Team OpenClaw dient als teamweiter Assistent in den Channe...